Guide Moderne de Réponse aux Incidents pour les Systèmes Cloud-Natifs et AI

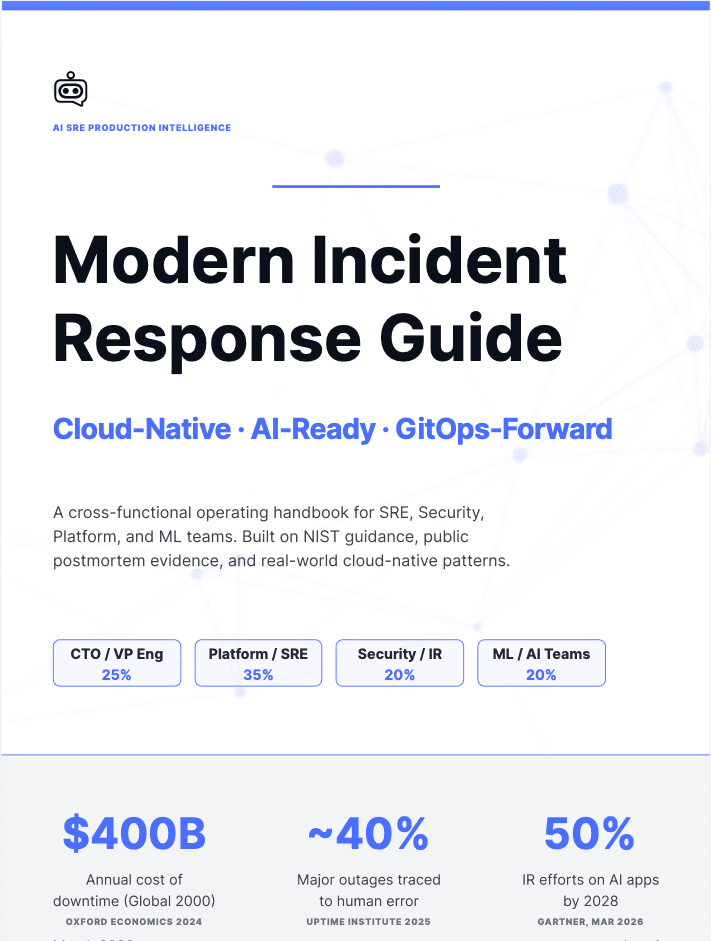

Un manuel opérationnel transversal pour les équipes SRE, Sécurité, Platform et ML. Fondé sur les directives NIST, les preuves de post-mortems publics et les patterns cloud-natifs du monde réel.

Ce que vous allez apprendre

L'analyse d'Oxford Economics a révélé que la dégradation de service représente environ 9 % des bénéfices des plus grandes entreprises mondiales — et la panne visible n'est qu'une partie des dommages. La traîne de récupération, l'exposition réglementaire et le détournement des efforts d'ingénierie portent une longue queue.

L'analyse de l'Uptime Institute montre que près de 40 % des organisations ont connu une panne majeure causée par une erreur humaine au cours des 3 dernières années — et parmi celles-ci, 85 % étaient liées à un non-respect des procédures ou à des défauts de processus. Le problème est la collision de la complexité avec la vitesse et la compréhension partielle.

La prévision de Gartner signale que les workflows de réponse prennent une forme AI. L'injection de prompts, le déni de service de modèles, l'abus d'outils, l'empoisonnement de la récupération — ce sont des problèmes de production maintenant. Les organisations ont besoin d'une gouvernance à la hauteur de l'accélération.

Le guide définit le modèle exécutif autour du Temps-de-Compréhension, du Contrôle du Rayon d'Impact, de l'Auditabilité des Décisions, de la Confiance dans la Récupération et de la Vélocité d'Apprentissage. La plupart des entreprises suivent le MTTR. Le guide explique pourquoi c'est la mauvaise métrique de départ.

Sept incidents post-2020 distillés en patterns structurels et leçons de conception de réponse. De l'événement de propagation mondiale de Fastly à la compromission du système de support d'Okta, en passant par la cascade de dépendances de LaunchDarkly. Aucun biais vendeur — juste ce qui s'est réellement passé et ce que cela enseigne.

De la résumé assisté à la remédiation supervisée jusqu'à l'autonomie contrainte — chaque niveau définit ce que fait l'AI, le risque principal qu'il introduit et la gouvernance requise. Inclut la raison pour laquelle 95 % des organisations n'obtiennent aucun retour sur investissement des pilotes GenAI (MIT Project NANDA, 2025) et comment éviter ce piège.